Werkbelastinggestuurde CPU-selectie: virtualisatie, AI, HPC en databases

Virtualisatie- en cloudwerkbelastingen: aantal cores, PCIe-lanes en I/O-throughput

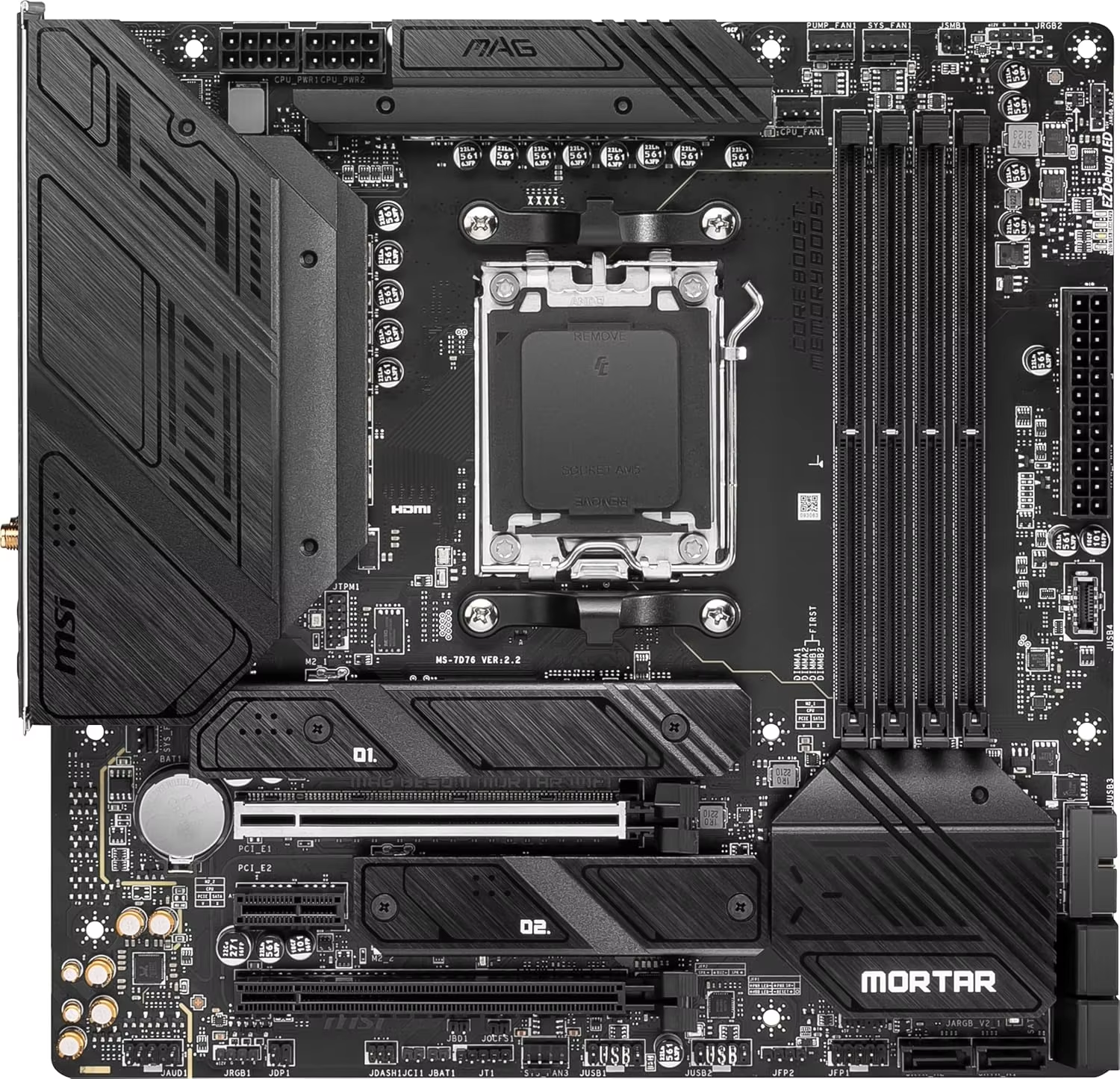

Bij het kiezen van CPU's voor virtualisatie- en cloudomgevingen is het van cruciaal belang om het juiste evenwicht te vinden tussen het aantal beschikbare cores en de input/output-capaciteit die ze bieden. Meer cores helpen zeker om meer virtuele machines op één fysieke host te plaatsen, aangezien elke virtuele machine zijn eigen set verwerkingsthreads nodig heeft om soepel te draaien. Maar hier is waar het mis kan gaan als we niet voorzichtig zijn. Alleen veel cores hebben is niet voldoende als het moederbord niet over voldoende PCIe 5.0-lanes beschikt. De meeste moderne hypervisorplatforms vereisen namelijk minstens 128 lanes om zowel snelle NVMe-opslagsystemen als GPU-verbindingen gelijktijdig te kunnen ondersteunen. Zonder voldoende I/O-bandbreedte merken gebruikers lastige latentieproblemen op zodra ze probeerden virtuele machines te verplaatsen. En laten we ook de geheugenkanalen niet vergeten. Een configuratie met 8 geheugenkanalen maakt een groot verschil bij het tegelijkertijd uitvoeren van zware databaseapplicaties en reguliere rekentaken, omdat dit voorkomt dat verschillende processen om beperkte bronnen strijden.

AI- en HPC-workloads: latentie per thread, geheugenbandbreedte en FP64/INT8-versnelling

Bij AI-training en zware HPC-workloads (High-Performance Computing) oefenen deze werkbelastingen eigenlijk verschillende soorten druk uit op CPUs. Parallel verwerken maakt zeker goed gebruik van multi-core-configuraties, maar er blijft nog steeds een ander belangrijk probleem bestaan: de latentie per enkele thread, die vooral bij voorverwerkingsstappen van groot belang is. Neem bijvoorbeeld BERT-modellen — als elke core langer dan 3 nanoseconden nodig heeft om te reageren, vertraagt batchverwerking met ongeveer 22%. En laat me niet eens beginnen over geheugenbandbreedte. Het verschil tussen systemen is verbluffend. Voer wat HPC-simulaties uit en zie wat er gebeurt: systemen met een bandbreedte van 850 GB/s verwerken berekeningen op het gebied van stromingsdynamica twee keer zo snel als systemen die beperkt zijn tot 400 GB/s. Gespecialiseerde FP64-eenheden ondersteunen wetenschappelijke modelleringstaken aanzienlijk, terwijl INT8-instructies ideaal zijn om inferentiewerkbelastingen soepeler te laten verlopen. Fabrikanten die deze functies overslaan, zien hun AI-training op basis van MLPerf-tests ongeveer 40% langer duren. Dat soort tijdsvertragingen compenseert zich snel in onderzoeksomgevingen, waar elk uur telt.

Transactiedatabases: waarom ECC-stabiliteit, cachegrootte en geheugentijdvertraging belangrijker zijn dan het aantal kernen

Bij transactiedatabases heeft stabiliteit voorrang boven blote snelheid. ECC-geheugen speelt een cruciale rol bij het voorkomen van die sluwe gegevenscorrupties waar we nooit op voorbereid zijn. Denk eens na over wat er gebeurt wanneer één bit in het geheugen omslaat. Volgens onderzoek van Ponemon uit 2023 kan dit soort fouten leiden tot enorme herstelkosten, rond de 740.000 dollar. Grote L3-caches met een capaciteit van ten minste 60 MB helpen wachttijden te verminderen, omdat zij veelgebruikte gegevens direct op de chip zelf bewaren. Hierdoor worden OLTP-query’s ongeveer 30% sneller uitgevoerd dan op systemen met kleinere caches. En hier is iets interessants dat niemand verwacht: het toevoegen van te veel processorcores vertraagt juist de prestaties. Tests met MySQL toonden aan dat computers met 32 cores transacties ongeveer 15% langer nodig hadden om te committen dan machines met slechts 24 cores, en wel door die vervelende NUMA-problemen. Voor iedereen die werkt met realtime-analyse is het verkrijgen van geheugenantwoordtijden onder de 80 nanoseconden veel belangrijker dan simpelweg het aantal cores binnen de processor te tellen.

Creatieve en technische professionele werkbelastingen: weergave, videobewerking en simulatie

3D-weergave en wetenschappelijke simulatie: de werkelijkheid van de prestaties van Threadripper Pro versus Xeon W versus EPYC

Het maken van hoogwaardige 3D-weergaven en het uitvoeren van complexe wetenschappelijke simulaties belasten de hardware echt tot aan de grenzen wat betreft parallelle verwerkingskracht. Werkstationprocessoren moeten een delicate balans vinden tussen het aantal kernen dat ze bevatten en de snelheid waarmee gegevens door het geheugen stromen. De AMD Threadripper Pro onderscheidt zich hier met zijn indrukwekkende opzet van 64 kernen en ondersteuning voor vier kanalen DDR5-geheugen. Voor gebruikers die werken aan simulaties op basis van eindige-elementenanalyse is een stabiele FP64-prestatie cruciaal. Het 12-kanaals geheugendesign van de EPYC-processor vermindert knelpunten met ongeveer 43% ten opzichte van systemen met slechts acht geheugenkanalen. Bij raytracing-taken heeft de Threadripper Pro een voordel door zijn grotere L3-cachegeheugens. Intels Xeon W-serie blijft intussen standhouden in CAD-toepassingen met één thread, waarbij responsiviteit het belangrijkst is. De meeste fysiekgebaseerde renderingsoftware schaalt vrij direct met het beschikbare aantal kernen, wat betekent dat meer dan 32 kernen bijna noodzakelijk wordt als artiesten renderduur willen reduceren van meerdere uren naar slechts enkele minuten. Thermisch beheer blijft eveneens een groot zorgpunt. Tijdens langdurige berekeningen voor computationele vloeistofdynamica kan warmteopbouw ernstig beperken wat deze krachtige systemen op termijn kunnen presteren, waardoor vloeistofkoeling niet langer alleen een luxe is, maar praktisch verplicht voor serieuze werkstationconfiguraties.

Video-bewerking en -codering: invloed van Quick Sync, AVX-512 en Unified Memory Architecture op de keuze van de CPU

De meeste video-bewerkingsopstellingen vandaag de dag richten zich echt op het verkrijgen van vloeiende realtimevoorvertoningen, terwijl ze tegelijkertijd die lange exportprocessen versnellen. Neem bijvoorbeeld Intel's Quick Sync-technologie: deze laat GPUs de H.265-coderingswerkzaamheden uitvoeren, waardoor het exporteren van 4K-tijdslijnen ongeveer 70% minder tijd kost dan wanneer u uitsluitend vertrouwt op software-rendering. Bij het werken met ingewikkelde kleurcorrecties en die geavanceerde LUT's kunnen de AVX-512-instructies in Xeon W-processors enorme hoeveelheden kleurgegevens in één keer verwerken, waarbij elke cyclus volledige 512-bit-blokken wordt verwerkt. De unified memory architecture (geïntegreerde geheugenarchitectuur) wordt ook uiterst belangrijk, vooral bij het omgaan met enorme 8K RAW-bestanden. Deze opstelling elimineert in feite al die vervelende vertraging die optreedt wanneer gegevens heen en weer moeten worden overgebracht tussen verschillende geheugengebieden. En hier is iets waar werkstationbouwers wel eens aan kunnen denken...

- Dual-CPU-configuraties leveren zelden voordelen voor video-bewerking vanwege NUMA-latentie

- H.266/VVC-codec-workflows vereisen ondersteuning voor hardwareversnelling

- 128 GB of meer DDR5 ECC-geheugen voorkomt frames die worden overgeslagen tijdens bewerking met meerdere camera’s

ProRes RAW-workflows vereisen een continue geheugenbandbreedte van meer dan 100 GB/s — een belangrijke maatstaf waarbij de PCIe 5.0-lanes van Threadripper Pro concurrerende oplossingen overtreffen.

Enterprise-grade CPU-functies die betrouwbaarheid en beveiliging garanderen

ECC-geheugen, hardwaregebaseerde beveiliging (AMD SME / Intel SGX) en firmwarevalidatie

Voor bedrijfsworkstations heeft de CPU speciale functies nodig om te voorkomen dat gegevens beschadigd raken of slachtoffer worden van beveiligingsbedreigingen. Neem bijvoorbeeld ECC-geheugen: dit detecteert vervelende bit-flipfouten tijdens het verwerken van gegevens. Dit is zeer belangrijk in sectoren zoals financiële modellering of genomisch onderzoek, waarbij zelfs één foutieve berekening het gehele resultaat kan verstoren. Daarnaast zijn er hardwarebeveiligingsmaatregelen zoals AMD’s geheugencryptie en Intel’s beveiligde uitvoeringsomgevingen. Deze maatregelen zetten letterlijk muren op op hardwareniveau om malware buiten de deur te houden, zonder de prestaties al te zeer te vertragen. Ook de firmware speelt een rol door bij elke opstart te controleren of alles correct wordt opgestart; dit voorkomt dat iemand de BIOS-instellingen wijzigt. Wanneer al deze technologische elementen samenwerken, vormen ze wat sommigen een driepuntige verdedigingsstrategie noemen voor bedrijven die absolute stabiliteit vereisen. Praktijktests tonen een daling van ongeveer 35–40% in systeemcrashes tijdens zware geheugengebruikstaken, en bovendien helpt dit bedrijven bij het naleven van regelgeving in sterk gereguleerde sectoren.

AMD versus Intel CPU-vergelijking voor enterprise-workstations

Afwegingen rond het aantal kernen: wanneer processors met veel kernen de reactiesnelheid bij interactieve werkbelastingen verlagen

Hoewel processors met een hoog aantal kernen uitzonderlijke doorvoer bieden voor parallelle taken zoals rendering of wetenschappelijke berekeningen, brengen ze vaak een daling van de reactiesnelheid bij interactieve werkbelastingen met zich mee. Real-timetoepassingen—zoals live datavisualisatie, CAD-bewerking of financiële modellering—vereisen lage latentie bij single-threadprestaties in plaats van een ruwe dichtheid aan kernen. Wanneer het aantal kernen meer dan 24–32 bedraagt, ontstaan er meerdere knelpunten:

- Planningsoverhead : het besturingssysteem introduceert latentie bij het beheren van threads, doordat taken tussen kernen worden overgeschoven

- Thermische beperkingen : agressief multi-core-boosten activeert throttling, waardoor de snelheid per kern daalt

- Geheugengebrek : meer kernen concurreren om bandbreedte van het werkgeheugen, wat de toegangslatentie verhoogt

Benchmarkgegevens tonen aan dat processoren met 64 kernen in interactieve scenario's tot 15–30% langzamer kunnen reageren dan vergelijkbare modellen met 16 kernen. Voor enterprise-workstations die gemengde werkbelastingen verwerken, leidt een evenwichtige configuratie met 16–24 kernen doorgaans tot een optimale balans tussen parallelle verwerking en responsiviteit voor de gebruiker—waardoor afnemende meerwaarde wordt voorkomen, waarbij extra kernen onbenut blijven terwijl kritieke voorgrondtaken stagneren.

Inhoudsopgave

-

Werkbelastinggestuurde CPU-selectie: virtualisatie, AI, HPC en databases

- Virtualisatie- en cloudwerkbelastingen: aantal cores, PCIe-lanes en I/O-throughput

- AI- en HPC-workloads: latentie per thread, geheugenbandbreedte en FP64/INT8-versnelling

- Transactiedatabases: waarom ECC-stabiliteit, cachegrootte en geheugentijdvertraging belangrijker zijn dan het aantal kernen

- Creatieve en technische professionele werkbelastingen: weergave, videobewerking en simulatie

- Enterprise-grade CPU-functies die betrouwbaarheid en beveiliging garanderen

- AMD versus Intel CPU-vergelijking voor enterprise-workstations