Wesentliche CPU-Metriken für B2B-Arbeitslasten

Taktfrequenz, Anzahl der Kerne und Threads: Erläuterung der Auswirkungen im praktischen Einsatz

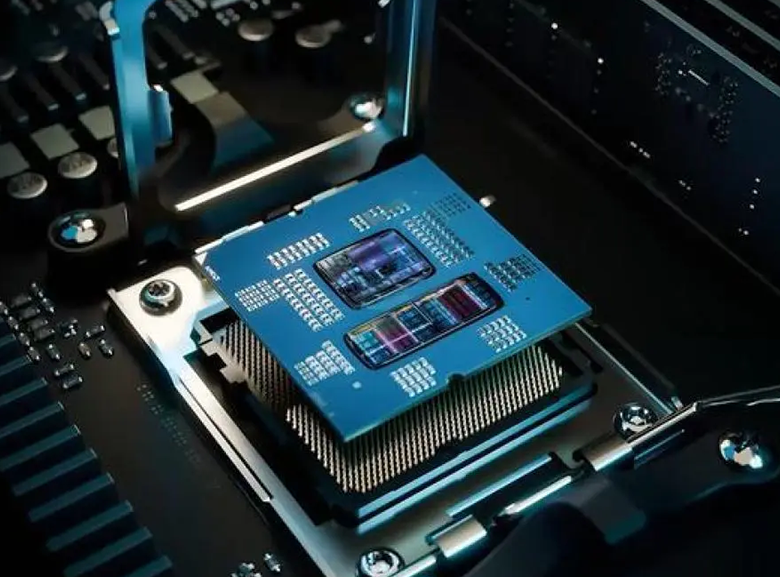

Die Taktfrequenz eines Prozessors, gemessen in Gigahertz, sagt uns im Grunde, wie schnell er einzelne Anweisungen verarbeiten kann. Dies ist besonders wichtig für Aufgaben, die auf Einzelthreads basieren, wie komplexe Finanzmodelle oder ERP-Systeme, die Transaktionen bearbeiten. Wenn wir über Kerne sprechen, beziehen wir uns auf tatsächliche Verarbeitungseinheiten innerhalb des Chips. Threads hingegen sind anders – sie stellen virtuelle Pfade dar, die durch Technologien wie Intels Hyper-Threading oder AMDs Simultaneous Multithreading erzeugt werden. Unternehmen, die mit mehreren Benutzern gleichzeitig Datenbanken abfragen oder mehrere ERP-Module parallel betreiben, benötigen Prozessoren mit einer großen Anzahl sowohl an Kernen als auch an Threads, um zu vermeiden, dass sie auf Rechenleistung warten müssen. Vier-Kern-Chips mögen für einfache Bürosoftware ausreichen, doch heutzutage stellen die meisten Unternehmen fest, dass sie mindestens acht Kerne benötigen, um den Betrieb reibungslos aufrechtzuerhalten, wenn alle Benutzer mit voller Kapazität arbeiten.

Cache-Größe, Speicherbandbreite und I/O-Durchsatz in Unternehmensanwendungen

Der L3-Cache, der in den meisten Enterprise-CPUs zu finden ist, reicht von etwa 16 MB bis hin zu 64 MB. Er fungiert als schneller On-Chip-Speicher, in dem der Prozessor häufig verwendete Anweisungen und Daten speichert, auf die regelmäßig zugegriffen wird. Bei transaktionalen Datenbanken macht ein gut abgestimmter L3-Cache einen großen Unterschied. Einige Studien zeigen, dass er den Zugriff auf den Arbeitsspeicher um etwa 30–35 Prozent reduzieren kann, was insgesamt eine geringere Latenz bedeutet. Die Speicherbandbreite, gemessen in Gigabyte pro Sekunde, gibt an, wie schnell Daten zwischen der CPU und dem Hauptspeicher übertragen werden. Für Echtzeitanalyse-Workloads und große Virtualisierungsumgebungen ist eine konstante Bandbreite von über 100 GB/s erforderlich, um mitzuhalten. Was den I/O-Durchsatz betrifft, so hängt dieser stark von Faktoren wie der Anzahl verfügbarer PCIe-Lanes und deren Version ab. Für NVMe-Speichergeräte, 10- oder 25-GbE-Netzwerkverbindungen sowie GPU-Kommunikation ist eine leistungsfähige I/O-Leistung entscheidend. Edge-Computing-Szenarien stoßen häufig auf Probleme, wenn nicht genügend Bandbreite vorhanden ist, um die hochfrequent hereinkommenden Sensordaten zu verarbeiten, insbesondere bei der Durchführung von KI-Inferenz direkt am Netzwerkrand.

CPU-Stufen-Vergleich: Von Einsteiger- bis hin zu Enterprise-fähigen CPUs

Die Auswahl der richtigen CPU-Leistungsstufe bedeutet, die Hardwarefähigkeiten an die Intensität der Arbeitslasten und die tatsächlich benötigten Operationen anzupassen. Einstiegs-CPUs mit Werten unter 2000 bewältigen Aufgaben wie grundlegende Bürosoftware oder einfache Datenaufzeichnungen recht gut, zeigen jedoch Schwächen, wenn mehrere Prozesse gleichzeitig ablaufen oder eine andauernde Auslastung vorliegt. Mittelklasse-Modelle mit Werten zwischen 2000 und 6000 bieten heutzutage ein gutes Gleichgewicht für die meisten geschäftlichen Anwendungen. Sie eignen sich hervorragend für mehrmodulige Enterprise-Ressourcenplanungssysteme, Netzwerküberwachungsanwendungen und sogar einfache Grafikarbeiten und liefern solide Leistung über mehrere Threads hinweg, ohne dabei zu hohe Kosten zu verursachen. Im oberen Segment sind Enterprise-CPUs mit Werten über 6000 speziell für kritische Systeme konzipiert, bei denen Ausfälle nicht akzeptabel sind. Dazu zählen Echtzeit-Industriesteuerungen, komplexe 3D-Modellierungssimulationen oder Hochgeschwindigkeits-Plattformen zur Finanzanalyse. Diese Chips sind darauf ausgelegt, auch unter Dauerbelastung kühl zu bleiben, verfügen über ECC-Speicherschutz gegen Fehler und haben oft längere Support-Zyklen, sodass Unternehmen darauf vertrauen können, dass sie rund um die Uhr reibungslos laufen. Bei der Infrastrukturplanung ist es sinnvoll, von Anfang an Skalierbarkeit einzuplanen. So können Unternehmen vermeiden, dass sie während der Nutzungsdauer ihre gesamten Systeme herausreißen und ersetzen müssen.

CPU-Architektur passend zu gängigen B2B-Arbeitslasttypen

CPU-gebundene Aufgaben: ERP, Datenbankverarbeitung und Finanzmodellierung

Die Leistung von ERP-Plattformen, relationalen Datenbanken und Finanzmodellierungstools hängt letztendlich davon ab, wie effizient sie Daten verarbeiten können. ERP-Systeme bewältigen komplexe, schrittweise Aufgaben in verschiedenen Geschäftsbereichen wie Buchhaltung, Lagerverwaltung und Mitarbeiterakten. Schnellere Prozessoren sind hier besonders hilfreich, da Vorgänge wie die Prüfung von Rechnungen oder das Erstellen von Berichten reibungslos nacheinander ablaufen müssen. Bei Datenbanken, die riesige Datenmengen verarbeiten, macht die Anzahl der Prozessorkerne einen großen Unterschied. Wenn mehrere Abfragen gleichzeitig ausgeführt oder zahlreiche Benutzeranfragen bearbeitet werden, leisten zusätzliche Kerne einfach bessere Arbeit. Auch Finanzanalysten bevorzugen Mehrkern-Systeme, insbesondere für Monte-Carlo-Simulationen, bei denen gleichzeitig Hunderte möglicher Ergebnisse analysiert werden. Die Größe des L3-Cache spielt ebenfalls eine große Rolle. Laut dem DataCenter Journal aus dem vergangenen Jahr senkte eine Erhöhung des L3-Cache um 10 % die Antwortzeiten von Datenbanken um etwa 15 %. Und nicht zuletzt sollte darauf geachtet werden, dass Komponenten ausreichend gekühlt bleiben, damit sie während intensiver Rechenphasen nicht langsamer werden.

Hybrid- und I/O-intensiven Workloads: Virtualisierung, Container-Orchestrierung und Edge-Computing

Bei virtualisierten und containerisierten Umgebungen ist es unerlässlich, dass Rechenleistung, Speicher und Ein-/Ausgabesysteme nahtlos zusammenarbeiten. Damit Hypervisoren ordnungsgemäß funktionieren, benötigen sie zahlreiche Prozessorthreads, damit virtuelle Maschinen effizient zugewiesen werden können, sowie ausreichende Speicherbandbreite, um Live-Migrationen und Situationen mit übermäßigem Speicherverbrauch zu bewältigen. Container-Orchestrierungstools wie Kubernetes sind stark auf skalierbare Prozessor-Kerne angewiesen, um Microservices schnell hochzuskalieren, und benötigen gleichzeitig Zugriff auf PCIe-Lanes für schnelle Netzwerkverkehrsbearbeitung und Speicheroperationen. An der Edge-Computing-Schnittstelle wird die Sache noch komplexer. Einzelhandelsgeschäfte und Fabriken, die lokale KI-Inferenz betreiben, müssen Sensor-Daten verarbeiten, die sofortige Bearbeitung erfordern, und dies alles unter begrenzten Bandbreitenbedingungen. Deshalb gewinnen moderne Prozessoren mit integrierten KI-Beschleunigungsfunktionen von Unternehmen wie Intel mit ihrer AMX-Technologie oder AMDs XDNA zunehmend an Bedeutung. Diese Chips, zusammen mit vollständiger Unterstützung für 64 Lanes PCIe 5.0, leisten einen entscheidenden Beitrag zur Beseitigung von Leistungsengpässen in verteilten Systemen, bei denen jeder Millisekunde zählt.

Zukunftssicherheit Ihrer CPU-Investition: Skalierbarkeit, Sicherheit und Bereitschaft für KI

Hardwarebasierte Sicherheitsfunktionen (z. B. Intel SGX, AMD SEV) für umsichtskritische Umgebungen

Vertrauenswürdige Ausführungsumgebungen, kurz TEEs genannt, wie Intels SGX und AMDs SEV-Technologie, schaffen sichere Bereiche im Computerspeicher, in denen sensible Informationen während der Verarbeitung geschützt bleiben. Dies sind nicht einfach nur herkömmliche Verschlüsselungsmethoden, wie sie allein in Software verwendet werden. Was sie besonders macht, ist ihre Fähigkeit, es böswilligen Akteuren unmöglich zu machen, Daten durch Memory-Scraping-Techniken zu stehlen, virtuelle Maschinen auf Hypervisor-Ebene zu manipulieren oder sogar die privilegiertesten Teile des Betriebssystems zu umgehen. Für Unternehmen, die mit Kundendaten arbeiten, ist dieser Schutz längst keine Option mehr. Die DSGVO-Vorschriften in Europa, HIPAA-Anforderungen für medizinische Unterlagen sowie PCI-Standards für Kreditkarteninformationen verlangen alle derartige Schutzmaßnahmen. Es gab bereits Fälle, bei denen Unternehmen nach Datenlecks mit Geldstrafen in Höhe von über 740.000 Dollar belegt wurden (laut Ponemon Institute aus dem Jahr 2023). Wenn Unternehmen Sicherheit direkt in ihre Hardware-Chips integrieren, anstatt sich ausschließlich auf Softwarelösungen zu verlassen, erhöhen sie tatsächlich ihre Widerstandsfähigkeit gegen Angriffe, sparen Zeit bei Audits und erzielen gleichzeitig eine gute Leistung, ohne Geschwindigkeit beim Umgang mit hohen Arbeitslasten einzubüßen.

KI-Beschleunigungsunterstützung: Wann integrierte CPU-Funktionen ausreichen und wann dedizierte Beschleuniger benötigt werden

Moderne Enterprise-CPUs verfügen über spezielle Befehlssätze wie AVX-512 von Intel, deren eigene AMX-Technologie und AMDs VNNI sowie eingebaute neuronale Verarbeitungseinheiten, die KI-Inferenzoperationen beschleunigen. Diese Funktionen eignen sich gut für leichtere bis mittlere KI-Aufgaben wie die Echtzeiterkennung von Betrug, die Berechnung von Scores für vorausschauende Wartung oder Prognosen zu strukturierten Lieferketten. Sie können eine Leistung von etwa 100 TOPS erreichen, ohne zusätzliche Hardware zu benötigen. Bei besonders rechenintensiven Aufgaben ändert sich dies jedoch. Für das Training großer Sprachmodelle, die Analyse von Rohvideomaterial oder die Sequenzierung ganzer Genome sind weiterhin leistungsstarke GPUs oder TPUs erforderlich. Bei der Auswahl zwischen den Optionen fallen mehrere Faktoren besonders ins Gewicht:

| Arbeitslastmerkmal | Szenario mit ausreichender CPU-Leistung | Szenario mit Notwendigkeit eines Beschleunigers |

|---|---|---|

| Skalierung der Operationen | <50.000 Inferenzen/Sekunde | >500K Inferenzen/sec |

| Datenkomplexität | Strukturierte Datensätze | Unstrukturierte Multimedia |

| Latenztoleranz | >10 ms Antwortzeit | Unter-millisekunde Antwortzeit |

Für Edge-Deployments bieten CPUs mit integrierter KI-Beschleunigung eine stromsparende, niedrige Latenz-Inferenz ohne zusätzliche Hardware-Komplexität. In zentralen Rechenzentren bleiben dedizierte Beschleuniger essentiell für das Training, die Großserien-Inferenz und heterogene KI-Pipelines.