Основні показники процесора, що мають значення для робочих навантажень B2B

Тактова частота, кількість ядер і потоків: розшифровка практичного впливу

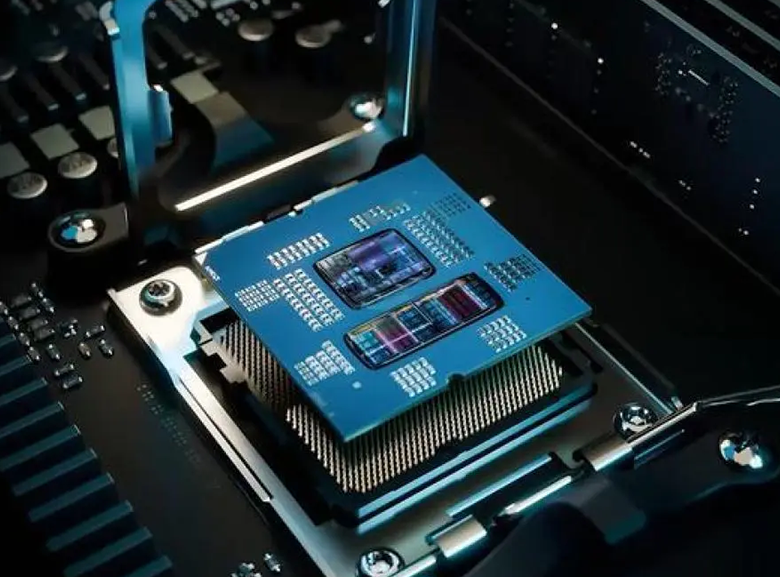

Тактова частота процесора, яка вимірюється в гігагерцах, по суті, показує, наскільки швидко він може обробляти окремі інструкції. Це має велике значення для завдань, що виконуються в одному потоці, таких як складні фінансові моделі або ERP-системи, які обробляють транзакції. Коли ми говоримо про ядра, то маємо на увазі реальні обчислювальні одиниці всередині чіпа. Потоки ж відрізняються тим, що являють собою віртуальні шляхи, створені за допомогою технологій, таких як Hyper-Threading від Intel або Simultaneous Multithreading від AMD. Бізнесу, який обслуговує багатьох користувачів, що одночасно отримують доступ до баз даних, або запускає кілька модулів ERP-системи паралельно, потрібні процесори з великою кількістю ядер і потоків, щоб уникнути простоювання через нестачу обчислювальних потужностей. Чотирьохядерні процесори можуть впоратися з базовими офісними програмами, проте сьогодні більшість компаній виявляють, що їм потрібно щонайменше вісім ядер, щоб забезпечити безперебійну роботу під час повного навантаження.

Розмір кешу, пропускна здатність пам'яті та продуктивність введення/виведення в корпоративних додатках

Кеш-пам'ять L3, яка використовується в більшості корпоративних процесорів, може становити від приблизно 16 МБ до 64 МБ. Вона працює як швидка пам'ять на кристалі, де процесор зберігає часто використовувані інструкції та дані, до яких регулярно відбувається доступ. Щодо транзакційних баз даних, наявність добре налаштованої кеш-пам'яті L3 має велике значення. Деякі дослідження показують, що це може скоротити звернення до оперативної пам'яті приблизно на 30–35 відсотків, що означає загалом нижчу затримку. Такий показник, як пропускна здатність пам'яті, вимірювана в гігабайтах за секунду, по суті вказує, наскільки швидко дані передаються між процесором і основною пам'яттю. Для навантажень у реальному часі та масштабних середовищ віртуалізації потрібна стабільна пропускна здатність понад 100 ГБ/с, щоб просто встигати за навантаженням. Щодо пропускної здатності введення-виведення (I/O), вона значною мірою залежить від таких факторів, як кількість доступних ліній PCIe та їхніх версій. У разі таких пристроїв, як накопичувачі NVMe, мережеві з'єднання 10 або 25 GbE та взаємодія з GPU, правильна організація введення-виведення має велике значення. Сценарії обчислень на периферії мережі (edge computing) часто стикаються з проблемами, коли немає достатньої пропускної здатності для обробки всіх даних із сенсорів, що надходять із високою частотою, особливо під час виконання висновків штучного інтелекту безпосередньо на краю мережі.

Порівняння рівнів процесорів: від початкового рівня до корпоративних процесорів

Вибір правильного рівня процесора означає відповідність можливостей апаратного забезпечення інтенсивності робочих навантажень та реальних потреб у операціях. Процесори початкового рівня з результатом менше 2000 добре справляються з такими завданнями, як базове офісне програмне забезпечення або простий запис даних, але починають гіркнути, коли відбувається кілька процесів одночасно або коли є постійне навантаження. Моделі середнього діапазону з результатом між 2000 і 6000 зараз забезпечують гарний баланс для більшості бізнес-застосувань. Вони чудово працюють у таких сферах, як багатомодульні системи планування підприємницьких ресурсів, екрани моніторингу мережі та навіть деякі базові графічні завдання, забезпечуючи стабільну продуктивність у багатопотоковому режимі без значних витрат. На верхньому рівні процесори корпоративного класу з результатом понад 6000 створені спеціально для критичних систем, де збої недопустимі. Наприклад, системи промислового управління в реальному часі, складні моделювання 3D-симуляцій або платформи швидкісного фінансового аналізу. Ці чіпи розроблені так, щоб залишатися холодними під навантаженням, мають захист пам'яті ECC від помилок і часто мають довші цикли підтримки, щоб підприємства могли розраховувати на їхню стабільну роботу цілодобово. Плануючи інфраструктуру, доцільно передбачити масштабованість з самого початку. Таким чином, коли обчислювальні потреби зростають з часом, компанії уникнуть необхідності повністю знімати та замінювати цілі системи на півдорозі їхнього корисного терміну.

Підбір архітектури ЦП для типових типів навантаження B2B

Завдання, обмежені потужністю ЦП: ERP, обробка баз даних та фінансове моделювання

Продуктивність платформ ERP, реляційних баз даних і інструментів фінансового моделювання залежить від того, наскільки ефективно вони можуть обробляти дані. Системи ERP виконують складні багатокрокові завдання у різних сферах бізнесу, таких як облік, управління запасами та облік працівників. Швидкодія процесора тут має велике значення, оскільки операції на кшталт перевірки рахунків або генерації звітів мають виконуватися плавно одна за одною. Для баз даних, що працюють з величезними обсягами інформації, наявність більшої кількості ядер процесора має принципове значення. Під час виконання кількох запитів одночасно або обслуговування багатьох запитів користувачів додаткові ядра працюють набагато ефективніше. Фінансовим аналітикам також подобаються багатоядерні конфігурації, особливо для симуляцій Монте-Карло, які одночасно враховують сотні можливих результатів. Великий обсяг кеш-пам'яті L3 теж має велике значення. Згідно з повідомленням DataCenter Journal минулого року, збільшення кешу L3 на 10% скоротило час відгуку бази даних приблизно на 15%. І, звичайно, не варто забувати про належне охолодження компонентів, щоб уникнути їхнього уповільнення під час інтенсивних обчислень.

Гібридні та інтенсивні робочі навантаження вводу/виводу: віртуалізація, оркестрація контейнерів та обчислення на периферії

Коли мова йде про віртуалізоване та контейнеризоване середовище, бездоганна взаємодія обчислювальних потужностей, пам'яті та систем введення/виведення є абсолютно необхідною. Для правильного функціонування гіпервізорів потрібна велика кількість обчислювальних потоків, щоб віртуальні машини можна було ефективно розподіляти, а також достатня пропускна здатність пам'яті для обробки живих міграцій та ситуацій із перевикористанням пам'яті. Інструменти оркестрування контейнерів, такі як Kubernetes, значною мірою покладаються на ядра процесора, здатні швидко масштабувати мікросервіси, а також потребують доступу до ліній PCIe для швидкої обробки мережевого трафіку та операцій із сховищем. Ситуація стає ще складнішою на рівні граничних обчислень. Роздрібні магазини та фабрики, що виконують локальний аналіз даних за допомогою штучного інтелекту, змушені працювати з даними від сенсорів, які потребують негайної обробки, одночасно дотримуючись обмежених умов пропускної здатності. Саме тому сучасні процесори із вбудованими функціями прискорення ШІ від таких компаній, як Intel із технологією AMX або AMD з XDNA, стають надзвичайно важливими. Ці чіпи разом із повною підтримкою 64 ліній PCIe 5.0 справді мають велике значення, коли йдеться про усунення вузьких місць продуктивності в розподілених системах, де кожна мілісекунда має значення.

Забезпечення майбутньої ефективності інвестицій у процесор: масштабованість, безпека та готовність до використання штучного інтелекту

Апаратні засоби безпеки (наприклад, Intel SGX, AMD SEV) для середовищ із критичними вимогами до відповідності

Середовища довіреного виконання, або скорочено TEE, такі як SGX від Intel та технологія SEV від AMD, створюють захищені області в оперативній пам’яті комп’ютера, де конфіденційна інформація залишається захищеною під час обробки. Це не просто звичайні методи шифрування, які ми бачимо лише у програмному забезпеченні. Їхня особливість полягає в тому, що вони перешкоджають зловмисникам крадіжці даних за допомогою методів сканування пам’яті, втручанню у роботу віртуальних машин на рівні гіпервізора чи отриманню доступу навіть до найпривілейованіших частин операційної системи. Для бізнесу, що працює з даними клієнтів, такого роду захист уже не є факультативним. Правила GDPR у Європі, вимоги HIPAA щодо медичних записів та стандарти PCI для інформації про кредитні картки всі вимагають саме такого захисту. Вже були випадки, коли компанії отримували штрафи понад сімсот сорок тисяч доларів після витоку даних (про це повідомляв інститут Ponemon у 2023 році). Коли компанії вбудовують безпеку безпосередньо в апаратні чіпи, а не покладаються виключно на програмні рішення, вони справді підвищують свою стійкість до атак, економлять час під час перевірок аудиторами та зберігають високу продуктивність, не жертвуючи швидкістю при обробці великих обсягів робочих навантажень.

Підтримка прискорення ШІ: коли достатньо інтегрованих можливостей ЦП, а коли потрібні спеціалізовані прискорювачі

Сучасні корпоративні процесори оснащені спеціальними наборами інструкцій, такими як AVX-512 від Intel, їхня власна технологія AMX та VNNI від AMD, а також вбудованими нейропроцесорними одиницями, що прискорюють операції виведення ШІ. Ці функції добре справляються з виконанням легких і середніх завдань ШІ, наприклад, виявлення шахрайства в реальному часі, розрахунок показників для передбачуваного обслуговування чи прогнозування структурованих ланцюгів поставок. Вони можуть забезпечити продуктивність близько 100 TOPS без необхідності додаткового обладнання. Але коли мова йде про справді важкі обчислювальні завдання, ситуація змінюється. Для навчання великих мовних моделей, аналізу необроблених відеоматеріалів чи секвенування повного геному все ще потрібні потужні GPU або TPU. Під час вибору між варіантами кілька факторів виокремлюються як особливо важливі:

| Характеристика робочого навантаження | Сценарій, коли достатньо ЦП | Сценарій, коли потрібні прискорювачі |

|---|---|---|

| Масштаб операцій | <50 тис. висновків/сек | >500K висновків/сек |

| Складність даних | Структуровані набори даних | Неструктуровані мультимедійні матеріали |

| Терпимість до затримок | >10 мс відгуку | Підмілісекундна відповідь |

Для розгортання на периферії процесори з інтегрованим прискоренням штучного інтелекту забезпечують енергоефективний інференс із низькою затримкою без додаткової апаратної складності. У централізованих центрах обробки даних спеціалізовані прискорювачі залишаються необхідними для навчання, масового інференсу та гетерогенних конвеєрів ШІ.

Зміст

- Основні показники процесора, що мають значення для робочих навантажень B2B

- Порівняння рівнів процесорів: від початкового рівня до корпоративних процесорів

- Підбір архітектури ЦП для типових типів навантаження B2B

- Забезпечення майбутньої ефективності інвестицій у процесор: масштабованість, безпека та готовність до використання штучного інтелекту