Metriae Fundamentales CPU Quae pro Rebus Gestis B2B Valent

Velocitas Horologii, Numerus Nucleorum et Numerus Thre adum: Effectus in Vita Reali

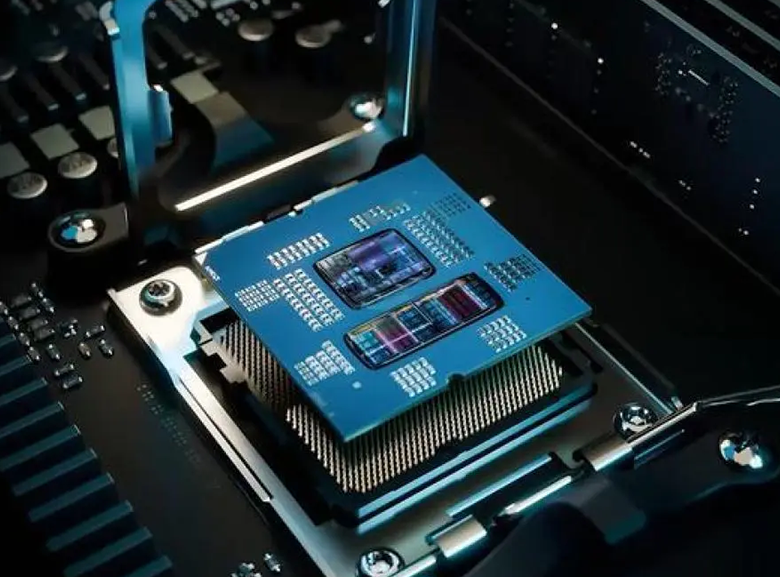

Velocitas horologiae processoris, in gigahertz mensurata, praecipue indicat quam cito instructiones singulares tractare possit. Hoc valde refert ad res quae in filis singularibus currunt, ut modella financiaria complexa vel systemata ERP transactiones tractantia. Cum de nucleis loquimur, unitates processionales reales intra tignum significamus. Fili autem alia sunt: vias virtuales significant, quae per technologiam ut Intel Hyper-Threading vel AMD Simultaneous Multithreading creantur. Negotia quae cum pluribus utentibus simul ad databases accedentibus negotiantur, vel plura simul modula ERP exequentia, processores multos tum nucleos quam filos habentes requirunt, ne expectando vires processionales tardentur. Tigna quadricorpora pro scriptis officinalibus simplicibus sufficere possunt, sed hodie pleraeque societates sese saltem octo corpora necesse habere inveniunt, ut operationes leniter currant, cum omnes plena potentia operantur.

Magnitudo Cachae, Lata Fascia Memoriae et I/O Permeatio in Applicationibus Enterprise

Copia L3 in plerisque CPU intra fines reperta a circiter 16MB usque ad 64MB patet. Hoc velut memoria rapida in-hippo agit ubi processus rationem tenet praeceptorum et datorum saepe usurpatorum quae frequenter acceduntur. In rebus transactionalibus, bene composita copia L3 magnam differt. Aliqui studii ostendunt accessus in RAM minui posse circa 30–35 pro cento, quod latitudo minorem denotat. Mensura largitudinis memoriae, in gigabytis secundum secundum, celeritatem fluxus datorum inter CPU et memoriam principalem indicat. Operae analyticae reali tempore et ingentes environment virtualium constantem largitudinem supra 100 GB/s requirunt modo ut sequantur. Nunc vero spectando perennationem I/O, haec valde pendet a factoribus ut numerus clivorum PCIe disponibilium et versio eorum. In rebus ut dispositiva stans NVMe, nexus 10 aut 25 GbE, et communicationibus GPU, recta perennatio I/O multum refert. Casus computandi ad limbum saepe in difficultatibus incidunt ubi largitudo non satis est ad omnia data sensorum altis frequentiis currentia tractanda, praesertim cum inferentia AI iuxta limbum retis fit.

Comparatio Graduum CPU: A CPU Gradus Initiales Usque ad Gradus Enterprise

Eligere debitum gradum CPU significat convenientiam inter id, quod machina effici potest, et intensitatem onerum operarum ac veras operationes quae necessariae sunt. CPU gradus introitus cum indicibus infra 2000 res bene tractant ut software basica in officiis aut simplices functiones annotationis datorum, sed laborem incipiant pati, quando plures processus simul fiunt vel quando continua necessitas in eos insistit. Modelli mediocres cum indicibus inter 2000 et 6000 hodie aequilibrium bonum praebent pro maioribus applicationibus commercialibus. Optime fungebuntur rebus ut systemata enterprise resource planning plurimodula, schermata observationis retis, etiamque aliquo opere graphico basico, firmitudinem praebentes per plures filos sine pecuniae nimia dispendio. In summo gradu, CPU enterprise grade cum indicibus supra 6000 ad fabricanda sunt pro systematibus criticis ubi defectus locus non habet. Cogita systemata realis temporis in regimine industriali, simulationes modellorum tridimensionalium complexarum, vel platformas analysionum financialium velocissimas. Haec elementa in pressione frigida manere student, cum protectione memoriae ECC contra errores muniantur, et saepe longiores vitae cursus habent, ut commercia super eos confidere possint horis tectis cotidie. Cum infrastructura paratur, rationabile est scalabilitatem ab initio includere. Ita, dum necessitates computatoriae tempore augescunt, societates totos systematum replacamentos mediocriter in usu evitant.

Architecturam CPU ad Typica Officia B2B Accommodare

Officia a CPU Occupata: ERP, Elaboratio Basi Datorum, et Modellicatio Financiaris

Praestantia platformarum ERP, databasis relationales et instrumentorum modelationis financialis ad id redit, quomodo efficaciter data tractare possint. Systemata ERP tractant complexa negotia gradatim per varias areas commerciales ut contabilitas, administratio inventariorum et acta emploiarum. Processores velocioribus hic multum iuvant, quia res sicut verificatio facturarum vel generatio reportorum oportet nimirum sine interruptione uno tempore exequi. Pro databasis quae magnitudines ingentes informationis tractant, plures nuclei processorum multum differre faciunt. Cum plures quaestiones simul exequuntur aut plura petitiones usorum tractantur, plures nuclei melius operantur. Analystae financiarii etiam dispositiva multiplex nucleorum amant, praesertim pro similationibus Monte Carlo quae centenas possibilium eventuum simul spectant. Etiam magnitudo cache L3 multum refert. Secundum DataCenter Journal anno superiore, augmentum cache L3 de 10% tempora responsionis databasis minuitum est circiter 15%. Et ne oblituri sumus componentes frigore servandos, ne tardentur dum sessiones computatoriae intensae fiunt.

Hybrida et Operis onerosi I/O: Virtualisatio, Container Orchestration, et Edge Computatio

Quando de environmentibus virtualizatis et containerizatis agitur, computandi, memoriae et systematum input/output coniunctionem omnino esse necessariam. Ad huiusmodi hypervisores recte funtionandum, multae tractationis fila requiruntur, ut machinae virtuales aequabiliter distribui possint, pariterque satis amplitudo memoriae ad migrationes activas et casus ubi memoria exsuperatur tractandas. Instrumenta conductoris continentiurn, qualia Kubernetes, valde in nucleis processorum innituntur, qui microservitia celeriter augere possunt, simulque ad vias PCIe adhibendas ad celerem rete commutationem et operationes immagazinandi. Res autem apud computationem marginalem (edge) etiam difficiliores fiunt. Emptionum loca et fabricae, quae inferentiam AI localem exeunt, cum data sensorum, quae statim tractanda sunt, contendunt, simulque intra limites angustos largitudinis operantur. Quam ob rem processores moderni, qui functiones accelerationis AI intrinsecas habent, velut apud Intel cum technologia AMX vel AMD cum XDNA, tantopere momenti esse incipiunt. Hi circuli, una cum plena PCI Express 5.0, 64 viarum, plene subactis, vere differre faciunt, cum de eliminandis angustiis praestantiae in systematis diffusis agitur, ubi omnis millisecondum ponderat.

Futuram Tuum CPU Investimentum Munire: Scalabilitas, Securitas et Praeparatio pro AI

Functiones Securitatis Instratae (exempli gratia, Intel SGX, AMD SEV) pro Ambientibus Adimplendi Criticis

Ambientia Executionis Fida, seu TEEs breviter, ut SGX a Intel et technologia SEV a AMD, regiones tutas in memoria computatrali creant ubi informationes sensibiles dum tractantur proteguntur. Haec non tantum vulgares methodi encryptionis sunt quas in software solum videmus. Quod eas speciales reddit est modus quo impedit ne mali actores data eruant per technicas "memory scraping", machinas virtuales turbent ad nivelem hypervisoris, vel etiam praeter partes maxime privilegiatas systematis operationis pergant. Pro mercatoribus qui cum datis customerum negotiantur, huiusmodi protectio iam non optabilis est. Normae GDPR in Europa, conditiones HIPAA pro archivis medicinalibus, et normae PCI pro informationibus cartarum creditoriis omnes huiusmodi protectiones exigunt. Vidimus casus ubi mercationes plagis ultra septingenta quadraginta milia dollariorum affectae sunt post effusiones datorum (Ponemon Institute hoc anno 2023 rettulit). Cum mercationes securitatem directe in chippis suis hardware includunt potius quam solis solutionibus software innixis, revera se tutiores adversus conatus fiunt, tempus servantes cum examinatores veniunt, et tamen bonam perfomantiam servant absque celeritate amissa dum magnae volumina operis tractant.

AI Acceleration Support: Quando Integratae CPU Facultates Sufficiunt vs. Quando Dedicati Acceleratores Necessarii Sunt

Modernae enterprise CPUs veniunt onustae specialibus instructionum seriebus ut AVX-512 e casa Intel, propria AMX technologia, et AMD VNNI, una cum intrinsecis nevralibus processandi unitatibus quae operationes AI inferendi accelerant. Haec instrumenta satis bene operantur ad leviora usque ad media AI opera tractanda, ut exempli gratia dolus in tempore reali detegendus, scores pro maintenance predictiva computandi, vel praedictiones de structuratis catenis supplicandi faciendae. Fere 100 TOPS perficientur sine ullo apparatu supplementario. Sed quando ad graviora computandi opera venitur, res mutatur. Magnorum linguae modellorum institutio, cruda videa analyzanda, vel totius genommatis ordinatio adhuc potentes GPUs vel TPUs requirit. Cum inter optiones deligere, multi factores maxime notabiles sunt:

| Characteristica Operum | Casus CPU Sufficiens | Casus Acceleratore Necessario |

|---|---|---|

| Operum Scalae | <50K inferentiae/sec | >500K inferentiae/sec |

| Complexitas datorum | Dataset structurati | Multimedia non structurata |

| Tolerantia Latentiae | >10ms responsus | Responsus sub-milliseundum |

Pro deploymentibus in margine, CPU cum acceleratione AI integrata offerunt inferentiam efficientem et tarditatem infimam sine complexitate hardware addita. In centris datis centralizatis, acceleratores dedicati manent necessarii pro addestrando, inferentia magni batch, et pipeline AI heterogeneis.