B2Bワークロードにおいて重要なコアCPUメトリクス

クロック速度、コア数、スレッド数:現実世界への影響を解説

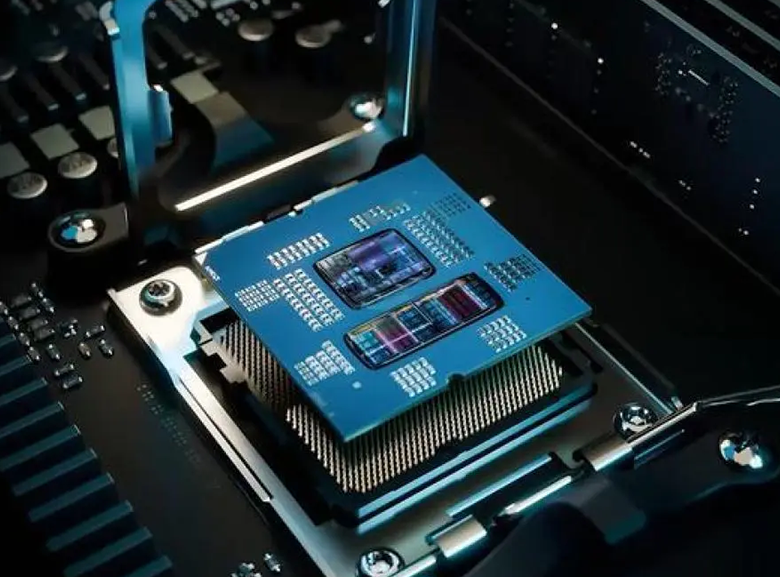

プロセッサのクロック速度はギガヘルツで測定され、基本的に個々の命令をどれだけ高速に処理できるかを示しています。これは、複雑な金融モデルやトランザクションを処理するERPシステムなど、シングルスレッドで動作するものにとって非常に重要です。コアとは、チップ内部にある実際の処理ユニットを指します。一方、スレッドはそれとは異なり、IntelのハイパースレッディングやAMDの同時マルチスレッディング(SMT)などの技術によって作成された仮想的な経路を表します。データベースに複数のユーザーが同時にアクセスしたり、複数のERPモジュールを並行して実行したりするビジネスでは、処理待ち状態にならないよう、多数のコアとスレッドを備えたプロセッサが必要です。クアッドコアのチップでも基本的なオフィスソフトには対応できますが、現在ではほとんどの企業が、全員がフル稼働している状況でも業務を円滑に進めるために、少なくとも8コアが必要だと感じています。

エンタープライズアプリケーションにおけるキャッシュサイズ、メモリ帯域幅、およびI/Oスループット

ほとんどのエンタープライズ向けCPUに搭載されているL3キャッシュは、約16MBから最大64MBまで幅広く存在します。これは高速なオンチップメモリとして機能し、プロセッサが頻繁に使用する命令や定期的にアクセスされるデータを保持します。トランザクションデータベースにおいては、適切にチューニングされたL3キャッシュを持つことが大きな差を生みます。いくつかの研究では、RAMへのアクセスを約30〜35パーセント削減できる可能性があり、つまり全体的な遅延が低下することを示しています。メモリバンド幅の指標はギガバイト毎秒(GB/s)で測定され、CPUと主記憶装置間でのデータ転送速度を示します。リアルタイム分析ワークロードや大規模な仮想化環境では、要求に追いつくために100 GB/sを超える一貫したバンド幅が必要です。次にI/Oスループットについてですが、これは利用可能なPCIeレーンの数やそのバージョンに大きく依存します。NVMeストレージデバイス、10または25GbEネットワーク接続、GPU間通信などにおいて、適切なI/O性能は極めて重要です。エッジコンピューティングのシナリオでは、特にネットワークエッジでAI推論を行う際に、高頻度で発生するセンサーデータを処理するのに十分な帯域幅がない場合、しばしば問題が生じます。

CPU レベル比較:エントリーレベルからエンタープライズグレードのCPUまで

適切なCPUレベルを選ぶということは、ハードウェアの性能を、ワークロードの強度および実際の業務要件に合わせることを意味します。スコア2000未満のエントリーレベルCPUは、基本的なオフィスソフトや単純なデータ記録作業には十分対応できますが、複数のプロセスが同時に発生したり、継続的に負荷がかかるとパフォーマンスが低下し始めます。現在、大多数のビジネス用途にとってバランスの取れた選択肢となるのは、スコアが2000から6000のミッドレンジモデルです。これらは、複数モジュールを利用するERP(企業資源計画)システム、ネットワーク監視画面、さらには基本的なグラフィックス作業などにも適しており、多スレッド処理において安定したパフォーマンスを提供しつつ、コストも抑えられます。トップクラスでは、スコア6000を超えるエンタープライズグレードのCPUがあり、これらの製品は障害が許されない重要なシステム向けに設計されています。リアルタイムの産業制御システム、複雑な3Dモデリングシミュレーション、あるいは高速金融分析プラットフォームなどが該当します。こうしたCPUは高負荷時でも冷却性を維持することに重点が置かれており、ECCメモリ保護機能によりデータエラーを防止でき、多くの場合長期サポートサイクルを備えているため、企業は24時間365日安定して稼働させ続けることが可能です。インフラを構築する際には、初めから拡張性を考慮しておくのが賢明です。これにより、将来的に計算処理の必要が増大しても、使用期間の途中でシステム全体を取り替えなくて済むようになります。

B2Bワークロードの一般的なタイプに対するCPUアーキテクチャの適合

CPUボトルネックタスク:ERP、データベース処理、および財務モデリング

ERPプラットフォーム、リレーショナルデータベース、および財務モデリングツールのパフォーマンスは、すべてデータをどれだけ効率的に処理できるかにかかっています。ERPシステムは、会計、在庫管理、従業員記録など、さまざまなビジネス分野にわたる複雑な段階的タスクを処理します。請求書の確認やレポートの生成といった処理は1つずつスムーズに実行される必要があるため、より高速なプロセッサがここでは大きな助けになります。大量の情報を扱うデータベースの場合、プロセッサコア数が多いほど大きな差が生じます。複数のクエリを同時に実行したり、多数のユーザー要求を処理したりする際には、追加のコアがより効果的に機能します。金融アナリストもまた、同時に数百の可能性のある結果を検討するモンテカルロシミュレーションにおいて、マルチコア構成を好んで使用しています。L3キャッシュのサイズも非常に重要です。昨年の『DataCenter Journal』によると、L3キャッシュを10%増加させたことで、データベースの応答時間が約15%短縮されました。そして、過酷な計算処理中にコンポーネントが速度低下を起こさないよう、十分に冷却することも忘れてはなりません。

ハイブリッドおよびI/O集約型ワークロード:仮想化、コンテナオーケストレーション、エッジコンピューティング

仮想化およびコンテナ化された環境において、演算、メモリ、入出力システムをシームレスに連携させることは極めて重要です。ハイパーバイザーが正常に機能するためには、仮想マシンを効率的に割り当てられるよう多数の処理スレッドが必要であり、ライブマイグレーションやメモリの過剰割り当てが発生する状況に対応できるだけのメモリ帯域幅も不可欠です。Kubernetesなどのコンテナオーケストレーションツールは、マイクロサービスを迅速にスケーリングできるプロセッサコアに大きく依存しており、高速なネットワークトラフィックの処理やストレージ操作のためにPCIeレーンへのアクセスも必要です。エッジコンピューティングのレベルでは状況はさらに複雑になります。小売店や工場でローカルAI推論を実行する場合、センサーデータを即座に処理しなければならず、同時に帯域幅が限られた環境下で動作する必要があります。そのため、IntelのAMX技術やAMDのXDNAなど、組み込み型AIアクセラレーション機能を備えた現代のプロセッサが非常に重要になっています。このようなチップとPCIe 5.0の64レーンに対する完全なサポートは、分散システム全体のパフォーマンスボトルネックを解消し、ミリ秒単位の差が重要な場面で大きな違いを生み出します。

CPU投資の将来対応:スケーラビリティ、セキュリティ、AI対応準備

規制対応が重要な環境向けのハードウェアベースのセキュリティ機能(例:Intel SGX、AMD SEV)

Trusted Execution Environments(TEE)は、IntelのSGXやAMDのSEV技術などとして知られ、コンピュータメモリ内に安全な領域を構築し、処理中の機密情報が保護されるようにします。これは単なるソフトウェア上の暗号化手法とは異なります。その特徴は、悪意ある攻撃者がメモリスキャニングによるデータ盗難、ハイパーバイザーレベルでの仮想マシンへの干渉、あるいはOSの最も高い権限を持つ領域すらも回避しようとする行為を防げる点にあります。顧客データを扱う企業にとって、このような保護はもはや任意ではなくなりました。欧州のGDPR規則、医療記録に関するHIPAA要件、クレジットカード情報に関するPCI基準は、いずれもこうした保護措置を求めています。実際、2023年にPonemon Instituteが報告した事例では、データ漏洩により74万ドルを超える罰金を科された企業もありました。企業がセキュリティ対策をソフトウェアに頼るだけでなく、ハードウェアチップ自体に直接組み込むことで、攻撃に対する安全性が高まり、監査時の対応時間の短縮にもつながり、大量の処理を行う際にもパフォーマンスを落とさずスピードを維持できます。

AIアクセラレーションのサポート:統合CPU機能で十分な場合と専用アクセラレータが必要な場合

最近のエンタープライズ向けCPUには、IntelのAVX-512や独自のAMX技術、AMDのVNNIといった特別な命令セットに加え、AI推論処理を高速化する組み込み型ニューラルプロセッシングユニットが搭載されています。これらの機能は、リアルタイムでの不正検出、予知保全のスコア算出、構造化されたサプライチェーンに関する予測など、軽量から中程度のAIワークロードに対して非常に効果的です。追加のハードウェアを必要とせずに、約100 TOPSのパフォーマンスを発揮できます。しかし、大規模言語モデルの学習、生のビデオ映像の分析、ゲノム全体の配列解析といった重い計算処理になると状況は変わります。このようなタスクには依然として強力なGPUまたはTPUが必要です。選択肢を比較する際には、以下のいくつかの要因が特に重要になります。

| ワークロードの特性 | CPUで十分なケース | アクセラレータが必要なケース |

|---|---|---|

| 処理規模 | <50K回/秒の推論 | >500K回/秒以上の推論 |

| データの複雑さ | 構造化データセット | 非構造化マルチメディア |

| 遅延許容範囲 | 応答時間10ms以上 | サブミリ秒レベルの応答 |

エッジ展開の場合、統合型AIアクセラレーション機能を備えたCPUは、追加のハードウェア複雑さを伴わずに、省電力で低遅延な推論を実現します。一方、中央集権的なデータセンターでは、トレーニングや大規模バッチ推論、および異種混合のAIパイプラインにおいて、専用アクセラレータが引き続き不可欠です。