Kärn-CPU-metriker som påverkar B2B-arbetsbelastningar

Klockfrekvens, antal kärnor och trådar: Förstå verkliga konsekvenser

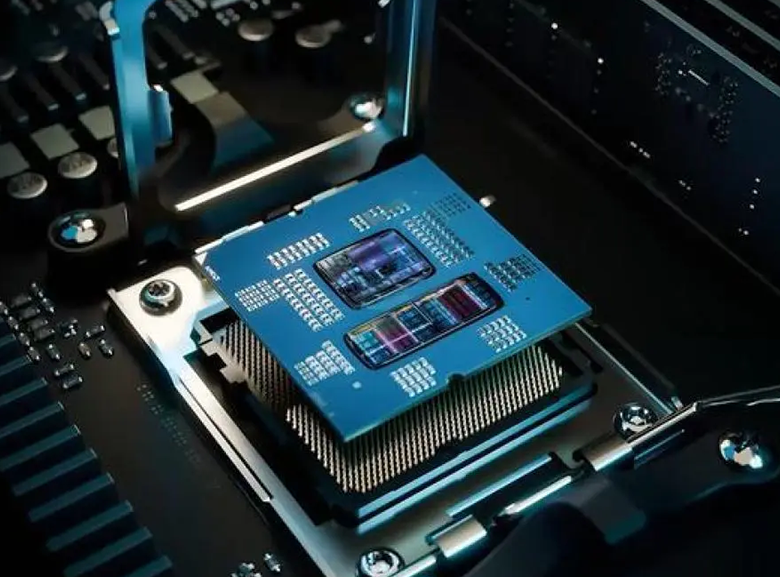

Klockfrekvensen för en processor, mätt i gigahertz, anger i grunden hur snabbt den kan hantera enskilda instruktioner. Detta är mycket viktigt för saker som körs på enstaka trådar, till exempel komplexa finansiella modeller eller ERP-system som hanterar transaktioner. När vi talar om kärnor syftar vi på faktiska processorenheter inuti chipet. Trådar är däremot något annat – de representerar virtuella vägar skapade genom teknik som Intels Hyper-Threading eller AMD:s samtidiga multitrådning. Företag som hanterar flera användare som får tillgång till databaser samtidigt, eller som kör flera ERP-moduler parallellt, behöver processorer med många både kärnor och trådar för att undvika att hamna i kö för bearbetningskapacitet. Fyra kärnors processorer kanske räcker till grundläggande kontorsprogram, men numera upptäcker de flesta företag att de behöver minst åtta kärnor bara för att driva verksamheten smidigt när alla arbetar i full kapacitet.

Cachestorlek, minnesbandbredd och I/O-genomströmning i företagsapplikationer

L3-cache minnet som finns i de flesta företags-CPU varierar från cirka 16 MB upp till 64 MB. Det fungerar som snabbt minne på chipet där processorn sparar vanligt använda instruktioner och data som ofta används. När det gäller transaktionsdatabaser gör en välavställd L3-cache en stor skillnad. Vissa studier visar att den kan minska åtkomsten till arbetsminnet med ungefär 30–35 procent, vilket innebär lägre latens överlag. Minnesbandbredden, som mäts i gigabyte per sekund, anger i grunden hur snabbt data flödar mellan CPU:n och huvudminnet. Realtidsanalysarbetsbelastningar och stora virtualiseringsmiljöer kräver konsekvent bandbredd över 100 GB/s för att kunna hålla takten. När det gäller I/O-genomströmning beror detta i hög grad på faktorer som antalet tillgängliga PCIe-länkar och vilken version de kör. För saker som NVMe-lagringsenheter, 10 eller 25 GbE-nätverksanslutningar och GPU-kommunikation är korrekt I/O mycket viktig. I edge-beräkningsscenarier uppstår ofta problem när det inte finns tillräcklig bandbredd för att hantera all den sensordata som kommer in med hög frekvens, särskilt vid AI-inferens direkt vid nätverkskanten.

Jämförelse av CPU-nivåer: Från startnivå till enterprise-klassade processorer

Att välja rätt CPU-nivå innebär att anpassa hårdvarans prestanda till arbetsbelastningens intensitet och vilka operationer som faktiskt krävs. Inträdesnivå-CPU:er med poäng under 2000 hanterar uppgifter som grundläggande kontorsprogram eller enkel datainsamling ganska bra, men börjar kämpa när flera processer sker samtidigt eller när belastningen är kontinuerlig. Mellannivåmodeller med poäng mellan 2000 och 6000 ger idag en bra balans för de flesta affärsapplikationer. De fungerar utmärkt för saker som flermoduliga ERP-system (Enterprise Resource Planning), nätverksövervakningsskärmar och även viss grundläggande grafikbearbetning, och levererar stabil prestanda över flera trådar utan att kosta en förmögenhet. I toppsegmentet är enterprise-gradade CPU:er med poäng över 6000 byggda specifikt för kritiska system där haverier inte är ett alternativ. Tänk på realtidsindustriella styrsystem, komplexa 3D-modelleringsimulationer eller höghastighetsplattformar för finansiell analys. Dessa kretsar är designade för att hålla temperaturen nere även under hård belastning, har ofta ECC-minnesskydd mot fel och erbjuder ofta längre supportlivscykler så att företag kan lita på att de fungerar smidigt dygnet runt. När man planerar infrastruktur är det klokt att bygga i skalbarhet från dag ett. På så sätt undviker företag att behöva plocka bort och ersätta hela system halvvägs genom deras livslängd.

Matcha CPU-arkitektur med vanliga B2B-arbetsbelastningstyper

CPU-bundna uppgifter: ERP, databasbearbetning och finansiell modellering

Prestandan för ERP-plattformar, relationsdatabaser och finansiella modelleringsverktyg handlar i slutändan om hur effektivt de kan bearbeta data. ERP-system hanterar komplicerade steg-för-steg-uppgifter över olika affärsområden som redovisning, lagerhantering och anställdares register. Snabbare processorer är särskilt till hjälp här eftersom uppgifter som att granska fakturor eller generera rapporter behöver köras smidigt en i taget. För databaser som hanterar enorma mängder information gör fler processorprocessorer stor skillnad. När man kör flera frågor samtidigt eller hanterar många användarförfrågningar fungerar extra kärnor helt enkelt bättre. Finansiella analytiker gillar också flerkärniga uppsättningar, särskilt för Monte Carlo-simuleringar som undersöker hundratals möjliga utfall samtidigt. Storleken på L3-cache är också mycket viktig. Enligt DataCenter Journal förra året minskade en ökning av L3-cache med 10 % databassvarstiderna med cirka 15 %. Och inte att förglömma: att hålla komponenterna tillräckligt kylta så att de inte saktar ner under intensiva beräkningssessioner.

Hybrid- och I/O-intensiva arbetsbelastningar: Virtualisering, containerorkestrering och edge-beräkning

När det gäller virtualiserade och containerbaserade miljöer är det absolut nödvändigt att få beräkningsresurser, minne och in-/ut-system att fungera sömlöst tillsammans. För att hypervisorer ska kunna fungera korrekt behöver de många processortråde så att virtuella maskiner kan tilldelas effektivt, samt tillräcklig minnesbandbredd för att hantera live-migreringar och situationer där minnet överbelastas. Orchestreringsverktyg för containrar, som Kubernetes, är kraftigt beroende av processorkärnor som snabbt kan skala mikrotjänster, samtidigt som de behöver åtkomst till PCIe-länkar för snabb hantering av nätverkstrafik och lagringsoperationer. Saker blir ännu knepigare på edge-computing-nivå. Butiker och fabriker som kör lokal AI-inferens måste hantera sensordata som kräver omedelbar behandling, allt medan de arbetar inom begränsad bandbredd. Därför blir moderna processorer med inbyggda AI-accelereringsfunktioner från företag som Intel med sin AMX-teknik eller AMD:s XDNA allt viktigare. Dessa kretsar, tillsammans med full support för 64 länkar av PCIe 5.0, gör verkligen en skillnad när man försöker eliminera prestandabrist i distribuerade system där varje millisekund räknas.

Säkra Din CPU-investering för Framtiden: Skalbarhet, Säkerhet och Beredskap för AI

Hårdvarubaserade Säkerhetsfunktioner (t.ex. Intel SGX, AMD SEV) för Miljöer med Strikta Efterlevnadskrav

Betrodda exekveringsmiljöer, eller TEE som det förkortas till, som Intels SGX och AMD:s SEV-teknik, skapar säkra områden inom datorns minne där känslig information förblir skyddad medan den bearbetas. Detta är inte bara vanliga krypteringsmetoder som vi ser i programvara ensamt. Vad som gör dem speciella är deras förmåga att förhindra att obehöriga stjäl data genom tekniker som minnesavsugning, manipulerar virtuella maskiner på hypervisor-nivå, eller till och med tar sig förbi de mest privilegierade delarna av operativsystemet. För företag som hanterar kunddata är denna typ av skydd inte längre frivillig. GDPR-reglerna i Europa, HIPAA-kraven för medicinska journaler samt PCI-standarderna för kreditkortsinformation kräver alla denna typ av skydd. Vi har sett fall där företag har blivit bötfälla för över sjuhundrafyrtiotusen dollar efter dataläckor (Ponemon Institute rapporterade detta redan 2023). När företag bygger säkerhet direkt in i sina hårdvarukretsar istället för att enbart lita på programbaserade lösningar, gör de verkligen sig själva säkrare mot attacker, sparar tid när revisorer kommer för granskning och uppnår fortfarande god prestanda utan att offra hastighet vid hantering av stora arbetsbelastningar.

AI-accelerationssupport: När integrerade CPU-funktioner räcker till respektive när dedikerade acceleratorer behövs

Moderna företags-CPU:er levereras med specialiserade instruktionssatser som AVX-512 från Intel, deras egna AMX-teknik och AMD:s VNNI, samt inbyggda neurala bearbetningsenheter som snabbar upp AI-inferensoperationer. Dessa funktioner fungerar ganska bra för att hantera lättare till medelstora AI-uppgifter, såsom att upptäcka bedrägerier i realtid, beräkna poäng för prediktiv underhåll eller göra prognoser om strukturerade supply chains. De kan leverera cirka 100 TOPS prestanda utan behov av extra hårdvara. Men när det gäller mycket tunga beräkningstaskar förändras läget. Att träna stora språkmodeller, analysera rå videomaterial eller sekvensera hela genomer kräver fortfarande kraftfulla GPU:er eller TPU:er. När man väljer mellan alternativ framträder flera faktorer som särskilt viktiga:

| Arbetsbelastningskarakteristik | Scenario där CPU räcker | Scenario där accelerator behövs |

|---|---|---|

| Driftskala | <50 000 inferenser/sek | >500K inferenser/sek |

| Datakomplexitet | Strukturerade datamängder | Ostrukturerad multimedieinformation |

| Latensfördrögningskapacitet | >10 ms svarstid | Submillisekunds svarstid |

För edge-distributioner erbjuder processorer med integrerad AI-acceleration strömeffektiv, låglatens inferens utan ökad hårdvarukomplexitet. I centrala datacenter förblir dedikerade acceleratorer avgörande för träning, storskalig inferens och heterogena AI-pipelines.